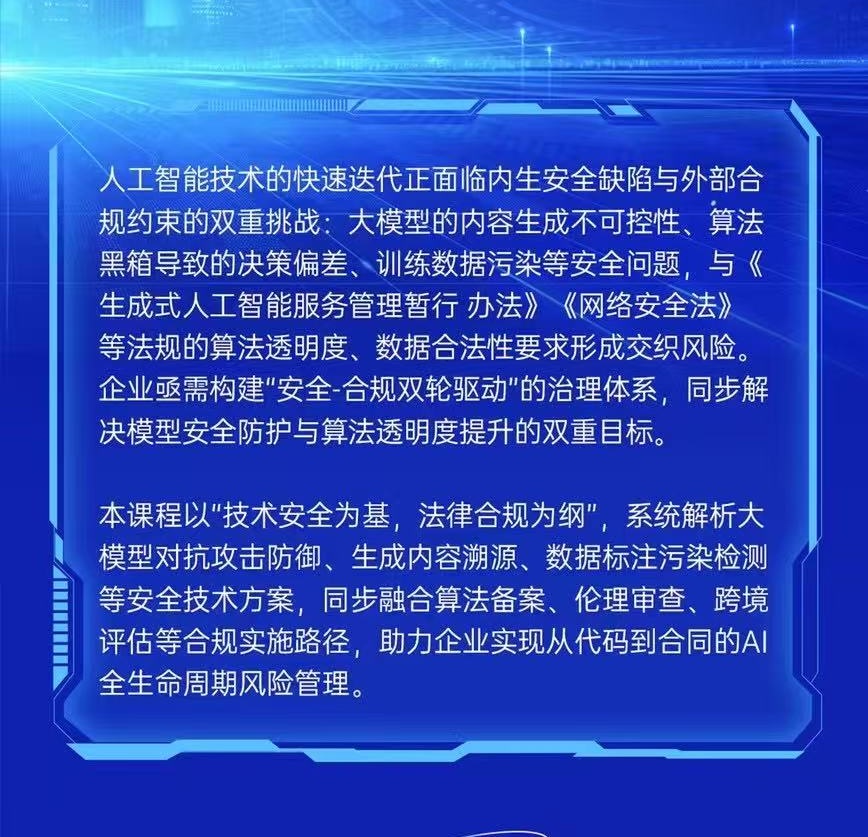

人工智能生成技术(AIGC)的潮流正席卷全球,它在内容创作领域以前所未有的效率重塑了传统规则,极大降低了文字、视频、图像和音频等合成制作的门槛。然而,由于人工智能存在幻觉问题、恶意传播以及法律法规更新滞后等问题的存在,使得生成式内容的制作与传播陷入了混乱状态。今年全国两会期间,代表委员们敏锐地注意到了上述问题,并就如何打击AIGC虚假信息、完善AI视频传播管理机制等方面提出了建议。

全国人大代表、科大讯飞董事长刘庆峰指出,生成式人工智能容易产生幻觉,尤其是深度推理模型逻辑自洽性的提高,使得AI生成的内容真假难辨。带有算法偏差的虚假信息会被新一代AI系统不断学习,形成恶性循环,进而影响公众信任和社会稳定。

全国人大代表、美的集团党委副书记、副总裁兼CFO钟铮观察到,随着AI技术的迅猛发展,视频合成和制作的门槛大大降低,导致网络上充斥着大量难以辨别真伪的AI生成视频内容。这些视频中,有的模仿名人或专家的声音进行传播,有的则虚构人物形象推销产品,误导消费者购买不必要的商品,甚至引发信任危机;还有些视频通过流量变现的方式加剧了这一乱象的发展。

TCL创始人、董事长李东 生表示,随着生成式人工智能技术的发展,深度伪造技术也在快速进步,一旦被不法分子利用,可能会引发新的社会问题。尽管我国相关立法已经开始关注这一问题,但现有的规章制度尚不成体系,缺乏具体的实施细则和明确的处罚标准。

对于深度伪造问题,全 国人大代表、小米集团董事长兼CEO雷军同样表达了关注。他认为,“AI换脸拟声”的不当使用已成为违法侵权的高发区,容易引发侵犯肖像权、个人信息泄露及诈骗等违法行为。AI深度合成技术因其素材获取便利、技术门槛低、侵权主体及手段隐蔽性强等特点,给治理带来了巨大挑战。

针对AI幻觉问题,刘庆峰建议构建安全可信的数据标签体系,提升内容可靠性:建立安全可信且动态更新的信息源和数据知识库,为不同类型的数据标注可信度和潜在危害,以降低AI幻觉出现的几率,增强生成内容的可靠性;同时研发AIGC幻觉治理技术和平台,定期清除幻觉数据,研究自动分析幻觉的技术与软件,开展幻觉自动分析、AIGC深度鉴伪、虚假信息检测等工作,并由相关部门定期清理幻觉数据,向公众提供AIGC幻觉信息的检测工具和服务。

关于AI生成视频的传播,钟铮提出了以下建议:一是完善法律法规体系,强化原创版权和隐私保护;二是探索利用AI技术审核AI合成的视频内容,确保审核的效率与准确性;三是加强行业自律与政府监管,严厉打击违法违规行为,促进行业健康发展。

李东生认为,为了规范这项新兴技术的合理应用,有必要要求深度合成服务提供商对AI生成的内容进行强制性标识,以减少恶意滥用,并明确责任归属。他提出了四点具体建议:第一,加速出台人工智能深度合成内容标识管理的规章制度;

第二,明确对未履行标识义务的服务商实施惩罚措施,细化未按要求标识的行为分类和相应的处罚标准;第三,强化深度合成内容标识的技术标准和管理,发布相关技术标准以确保标识的有效性;第四,推动国际合作,共同构建有效的AI生成合成内容监管机制。

CCRC中国网络安全审查技术与认证中心人工智能安全全景治理与合规突围——企业 AI 治理学习北京青蓝智慧科技马老师:135 - 2173 - 0416 / 133 - 9150 – 9126

雷军则建议,首先应加快推进专门法律的立法进程,在保障安全的同时提升立法层次;其次,加强行业自律共治,压实平台企业等各方的责任与义务;最后,加大普法宣传力度,提高民众的警惕性和鉴别能力。